流媒体编解码技术

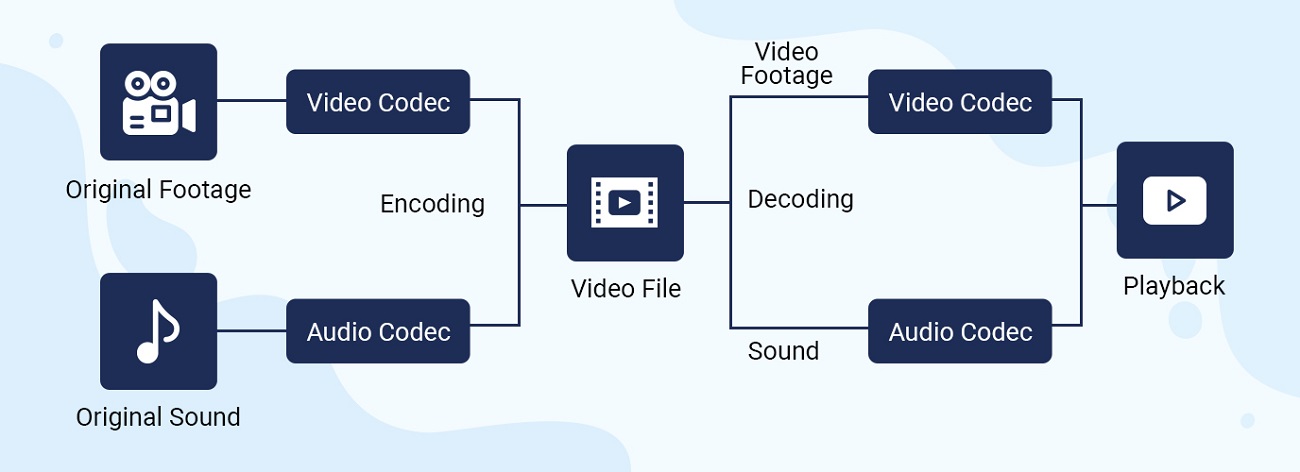

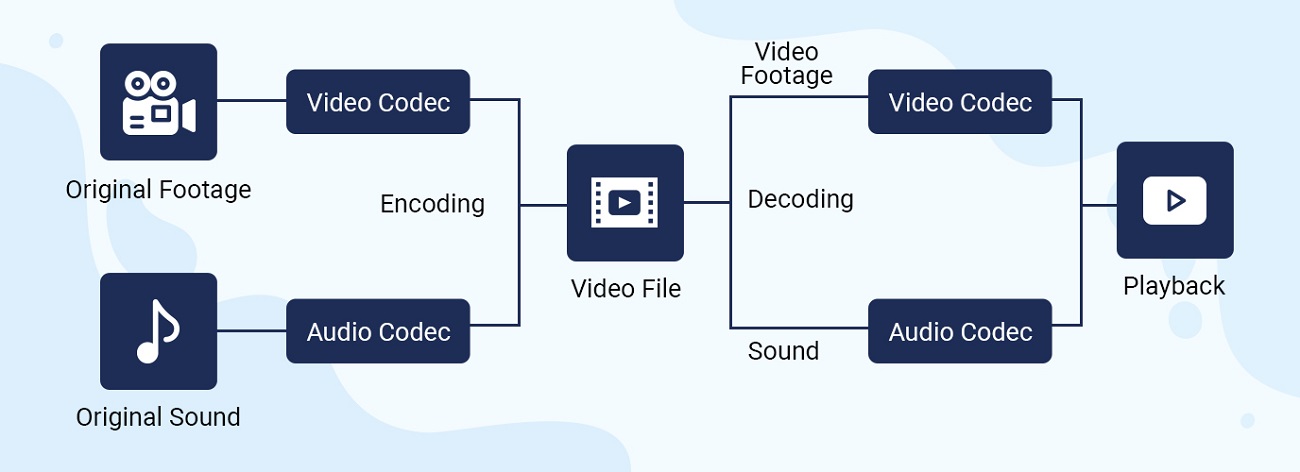

音/视频压缩编码技术是多媒体计算机、多媒体数据库、多媒体通信、数字电视和交互式系统中的关键技术,它也是流媒体技术的核心之一,它是将原来不适合当今网络传输的大体积文件转化成可以适合网络传输的小体积文件的关键,通常称之为压缩编码技术。文件传输到用户端,将编码后的数据恢复成原来的音/视频信号,就是所谓的解码过程。

编解码技术伴随着计算机和通信技术而发展。编码的本质就是对各种信息,根据其特点采用一定的方案,将其转化成能够被计算机识别的字符串。计算机只能识别0和1,所以,最终编出的码流肯定是0和1的各种组合,对端再根据一定的规则还原成原始的信息。PCM编码是最早的对于声音信号进行抽样量化的编码方式,是各种编码理论的基础。编码技术的蓬勃发展提高了信息处理、传输和存储效率。正如前面所说,编解码的方案是多种多样的,流媒体技术的核心价值在于能尽可能降低文件大小且保证音/视频的质量。

流媒体的本质是媒体,流是媒体传递过程中的一种表现形式。媒体的编码本质就是音频编码和视频编码,然后将两者同步传送,形成媒体流。相比传统的音频和视频的编码方法,流媒体的关注点如前所说,在于降低文件大小,使之能够减少带宽压力,也就是说,除了要做到和传统编码相同的功能之外,压缩是流媒体编码的重点考虑因素。所以,流媒体中的编码技术通常也称作压缩编码技术。如果不采用压缩编码方式,而是直接进行编码的话,我们不考虑音频编码,只考虑视频编码,活动图像(如电影)一般是采用24帧(或30帧)每秒的方式来播放,每帧图片按1080x720像素计算,每个像素需要占用16比特,那么,需要的带宽就是298.5984Mbps的速率,这个速率是Internet所无法承受的。同时,15秒的未压缩图像将占用567MB的内存空间,这对于大多数只能处理小图像片段的台式计算机来说都是不可接受的。

如何既要保证不影响人们的感官,又可同时降低码流带宽,是流媒体编码技术的关键。相对来说,解码只是对编码数据的恢复,虽然也很重要,但不是技术的关键。

从目前的主要技术来看,虽然压缩编码技术很多,但是目前得到市场认可的主要有微软的WMV标准、ISO的移动图像专家组MPEG开发的MPEG系列标准,以及ITU-T和ISO两个国际标准化组织的有关视频编码的专家联合组成的JVT(JointVideoTeam,视频联合工作组)开发的H.264标准。标准化是产业化活动成功的前提,编码的各种国际标准的制定集中地反映了音/视频压缩编码技术发展的水平。下面将对这几种标准分别做简单介绍。

1、MPEG简介

MPEG成立于1988年,是ISO(The International Organization for Standardization,国际标准化组织)和IEC(International Electrotechnical Commission,国际电工协会)联合工作委员会(JTC1)在信息技术方面的下属研究小组(ISO/IECJTC1/SC29/WG11),其任务是研究低速率下的视频和斉频编码标准方案。MPEG小组于1992年11月和1994年11月分别制定了两个ISO标准,MPEG-1和MPEG-2,其目的是在一种可接受的质量下,把视频及其伴音信号速率分别压缩为1.5Mbps和10Mbps左右,并在CDROM、数字电视和HDTV(High Definition Television,高清晰度电视)等领域中得到了广泛应用。

MPEG图像编码包含三个成分:I帧、P帧和B帧。在MPEG编码过程中,一些图像压被缩成I帧,一些被压缩成P帧,另一些被压缩成B帧。1帧压缩可以得到6:1的压缩比而不产生任何可觉察的模糊现象。在对I帧进行压缩的同时对P帧进行压缩,可以达到更高的压缩比而无可觉察的模糊现象。B帧压缩可以达到200:1的压缩比,其文件尺寸一般为I帧压缩尺寸的15%,不到P帧压缩尺寸的一半。I帧压缩去掉图像的空间冗余度,P帧和B帧去掉时间冗余度。

I帧压缩采用基准帧模式,只提供帧内压缩,即在把帧图像压缩到I帧时,仅仅考虑了帧内的图像。I帧压缩不能除去帧间冗余度。帧内压缩基于离散余弦变换(Discrete Cosine Transform,DCT),类似于JPEG(Joint Picture Expert Group,静止图像专家组)和H.261图像中使用的DCT压缩标准。

P帧釆用预测编码,利用相邻帧的一般统计信息进行预测。也就是说,它考虑运动特性,提供帧间编码。P帧预测当前帧与前面最近的I帧或P帧的差别。

B帧为双向帧间编码,它从前面和后面的I帧或P帧中提取数据。B帧基于当前帧与前一帧和后一帧图像之间的差别进行压缩。

MPEG-1编码标准(ISO/IEC11172)包含五个部分,依次为系统、视频、音频、验收实验和软件模拟。其中,验收实验部分规定设备厂家和比特流制作者确保符合标准的认证方法,而软件模拟部分列出了一套实现MPEG-1标准(编码器和解码器)的C语言。其核心技术参考了相关标准化组织的研究成果,如JPEG和H.261等。运动图像的帧内编码技术釆用了JPEG推荐的DCT(离散余弦变换)技术,除此之外,还釆用了独特的帧间压缩编码技术(运动补偿技术)。其音频编码标准(ISO/IEC11172-3)提供了在32kHz、44.1kHz和48kHz取样率的单声道和双声道编码。MPEG-1的特点是它是一种有损的非平衡编码。有损意味着为达到低比特率,一些图像和伴音信息将丢失。通常这些信息是人眼和人耳最不敏感的信息,因此,即使以1*CD-ROM的速率压缩也能达到VHS的图像质量和高保真立体声的效果。MPEG釆用非平衡编码意味着编码一幅图像比解压缩慢得多。MPEG-1的数据流包含图像流、伴音流和系统流三种成分。图像流仅包含画面信息,伴音流包含声音信息,系统流实现图像和伴音的同步。所有播放MPEG图像和伴音数据所需的时钟信息都包含在系统流中。

MPEG-2编码标准(ISO/IEC13818)同样包含了类似MPEG-1的相同的五个部分。MPEG-2由于其极其丰富的应用,釆用了独特的工具箱途径,用于不同目的的不同编码工具被开发出来并标准化。工具的不同装配,所谓档次(Profile),也被标准化,并能用之服务于不同需要。每个档次一般对一些参数(如图像尺寸),有不同的级别(Level),通过这些参数来适应不同的应用。MPEG-2音频编码标准在与MPEG-1兼容的基础上实现低码率和多声道扩展。它在包含五个全带宽声道和一个低频带扩展层(LFE)后,其比特率可以达到1Mbpso同时,MPEG工作组于1997年4月完成了一个不考虑与MPEG-1兼容的高质量音频编码标准(ISO/IEC13818-7),定名为MPEG-2先进编码标准(AdvancedAudioCoding,AAC),AAC提供从8〜96kHz取样频率的I〜48频道的高质量音频编码,其码率从8kbps的单声道语音到超过160kbpsoAAC与MPEG-1的低取样率及多声道编码标准不同,它并不提供对MPEG-1标准的后向兼容性,从而具有更好的压缩效果。

在MPEG-4制定之前,MPEG-1、MPEG-2、H.261和H.263都是釆用第一代压缩编码技术,着眼于图像信号的统计特性来设计编码器,属于波形编码的范畴。第一代压缩编码方案把视频序列按时间先后分为一系列帧,每一帧图像又分成宏块以进行运动补偿和编码,这种编码方案存在以下缺陷。

• 将图像固定地分成相同大小的块,在高压缩比的情况下会出现严重的块效应,即马赛克效应。

• 不能对图像内容进行访问、编辑和回放等操作。

• 未充分利用人类视觉系统(HumanVisualSystem,HVS)的特性。

在此之后,MPEGT.作组又开始制定一种新的试听标准MPEG-4,其本意是为了研究甚低速率下的视听标准,但为了满足当今世界越来越多的视听材料要以数字形式进行相互交换而产生的种种需求,其目标已经彻底改变了。相对于MPEG的前两个压缩标准,MPEG-4已经不再是一个单纯的视频、音频编码标准,它更多定义的是一种格式和框架,而不是具体的算法,从而为多媒体数据压缩提供了一个更广泛的平台。标准糅合了各种现有的多媒体技术,包含压缩本身的一些工具、算法和图像分析与合成、计算机视觉、计算机图形、虚拟现实,以及语音合成等技术。标准的主要特征是基于对象(Object-based)的编码和基于模型(Model-based)的编码。此外,为了适应Internet和无线网等窄带视频通信、多质量视频服务及多媒体检索等服务,MPEG-4提供了基于对象的分级功能,包括时域与空域的分级及其混合分级。反映在音频上,MPEG-4将音频的合成编码和自然编码结合起来,并对其进行对象操作,提供了相应的码流比特率和编码复杂度的解析比功能等MPEG-4特有的特性支持。

MPEG-4釆用了对象的概念,不同的数据源被视作不同的对象,而数据的接收者不再是被动的,它町以对不同的对象进行自己的操作:删除、添加和移动等。这种基于对象的操作方法是MPEG-4与MPEG-1和MPEG-2本质的不同。语音、图像和视频等可以作为单独存在的对象,也可以集合成一个更高层的对象,我们称之为场景。MPEG-4用来描叙其场景的语言叫Binary Formatfor Scenes(BIFS,二进制格式场景)。BIFS语言不仅允许对场景中对象进行删除和添加,而且可以改变对象的属性,可以控制对象的行为——这可以进行交互式应用。

MPEG-4对多媒体数据的标识方法是全新的、灵活多变的,其传输、存储和解码等方式也一样。对象存为所谓的元素流(ElementaryStream,ES)。BIFS对对象的操作被转换成对ES的操作。MPEG-4通过对象描叙符(ObjectDescriptor,OD)来辨明ES的对象归属。OD通过元素流描叙符(ElementaryStreamDescriptor,ESD)来通知系统流解码所需的解码器。在:传输层中,ES被分解成数据包,包头含有时间序列信息,解码器依靠此信息进行标准解阳。

在视频低码率压缩方面,MPEG-4引入了视频对象1(11(VideoObjectPlane,VOP)的概念,其在无线视频传输系统中达到10kbps的低速率。为此,它使用了多种技术来克服不可修复的错误来保证解码器的正常「作,比如,再同步标记和可逆可变长度编码技术。同时,编码端提供了多层次质量的编码以适应解码端在比特率方面的限制。当场景中含有不同的对象时,允许传送最重要的对象或对不同的对象实施不同的传输质量保证。被称之为精灵(Sprites)的技术用来在传送不变的背景时节省比特率,它使得在接收端改变视角时背景只传送一次。更为重要的技术是具体视频对象的计算机建模,通过此技术可以使用对象的参数化操作来代替物体的具体运动,而且,其计算由本地端完成。例如,事先定好的人脸模型可以通过少数的表情状态和独立的模型运动来模仿人脸具体动作。在预期的MPEG-4语音合成界面中,人脸模型与人脸中唇和眼部等特征模型有其特定的操作命令使之与语音同步。

MPRG-4音频对象可以分为自然音频对象和合成音频对象两类。MPEG-4自然音频对象涵盖了从2kbps到超过64kbps的各种传输质量的编码。MPEG-4定义了参数编码、CELP编码和时频编码三种编码器,用来协调T作以在整个码率范围内都得到高质量的音频。自然音频对象的编码支持各种分机编码功能和错误恢复功能。合成音频对象包括结构音频(StructuredAudio,SA)和文语转换(TextToSpeech,TTS)»结构音频类似乐器数字接口(MusicalInstrumentDigitalInterface,MIDI)语言,它采用描叙语音的方法来代替压缩语音。TTS接受文本输入并输出相应的合成语音,在应用时,通常与血部动画及唇语合成等技术结合起来使用。此外,音频对象还含有对象的空间化特征,不同的空间定位决定了音源的空间位置,这样可以使用人工或自然语音来营造人工声音环境。

先前的MPEG-1和MPEG-2标准立足于数据压缩,MPEG-4则从一个更高的层次上,即对象的概念上来考虑数据压缩问题,它使用了内容相关的编码方法。而MPEG-7则从认知的角度上来考虑。总的说来,MPEG-1、MPEG-2和MPEG-4目标是对信息进行有效表示,而MPEG-7则对信息的表示方法进行描述。或者说,前三者使得信息的内容变为可获取,而MPEG-7则使我们在需要的时候找到它。

MPEG-7定义了一个标准描述符集合(Standard Setof Descriptions,SSD)用于描述各种类型的多媒体数据,与之相应的描述方案(DescriptionSchemes,DS)用于规范多媒体描述符的生成和不同描述符之间的有机联系。这些描述符与所指定的多媒体对象的内容紧密联系,采用提取对象特征的方法为实现基于内容和语义的准确检索提供接口。在此基础上,MPEG-7定义了一种新的语言-描述定义语言(Description Definition Language.DDL)用于指定和生成描述方案。由于MPEG-7描述的多媒体对象范围极其广泛,其核心部分DDL语言将充分吸收现有的各种媒体描述语言的特点,以达到对多媒体数据的普遍适用性。主要采纳的语言包括SGML(StandardGeneralizedMarkupLanguage,标准通用标记语言)、DSSSL(Document Style Semanticsand Specification Language,文件样式语义与规范语言)、SPDL(Standard Page Description Language,标准页面描述语言)、HTML(Hyper Text Markup Language,超文本标记语言)和SMDL(Standard Music Description Language.标准音乐描述语言)等。

MPEG-4中提岀的基于对象编码的思想将成为对多媒体数据库中音/视频对象进行处理(包括特征提取和压缩编码)的基本手段,而MPRG-7的多媒体内容描述模块将对MPEG-l、MPEG-2和MPEG-4起到性能提高和功能扩展的作用。简言之,MPEG-1.MPEG-2和MPEG-4既是MPEG-7的工具和手段,也是MPEG-7的应用对象.

多媒体信息消费方式的变化要求在各种不同的网络间实现数据交换,在这方面,MPEG采取了一种和ITU-T不同的标准化道路。MPEG定义了多媒体数据的表示方式,力图使大多数应用能够共享其数据格式,得到最大限度的互用性。MPEG-4在语音和音频编码方面的工作提高了宽带应用范围和多媒体服务的完全解决方案,相当于许多现存编码标准的功能超集。因为它提供了新功能和许多MPEG-4特有编码工具的集成。基于MPEG-4的IP电话系统将在包丢失和传输比特率变化的情况下提供更好的鲁棒性。在音/视频应用时,由于MPEG-4独有的基于音/视频对象的编码方式,也提高了其音/视频的编码质量。在无线电通信系统中,其提供了语音编码和误差保护的灵活的比特率分配方式,这使得其获得了更好的误差鲁棒性。此外,传统的ITU-T专注于实时通信,而MPEG-4则同时关注存储媒体,其回放速度改变功能在快速数据库搜索中有很大应用,同时提供包括正在受到日益关注的知识产权保护问题上的功能支持。

从另一个角度来说,目前的消费者还是过于依赖服务提供端。因此,包括多媒体数字音/视频服务很大程度上依旧只是不同内容的简单集合,从而导致消费者局限于享受地域性的服务。由于特定环境内服务提供商的数目有限,这是很自然的事情。但是,随着交互式的宽带网络的出现,比如宽带WWW(WorldWideWeb,万维网),提供了这样的一个可能性,使个人能成为一个内容提供商,其服务是基于通用基础上的。

这种努力的目的就是使消费者的选择全球化,很少有标准能提供类似的应用。这样就有必要标准化一个界面和协议,从而使得消费者能够接受大范围内的内容提供商的服务。以消费者为中心的考虑可以在一个广泛的基础上拓展商业机会,各种类型的内容和服务提供商都可以得到以前所达不到的消费者市场,而这就是MPEG-21项目所要完成的任务。作为MPEG-7的后续作业对象,MPEG-21主要规定数字节目的网上实时交换协仪。

由于多媒体内容的处理涉及许多不同的平台,关系到数字资产权力保护等诸多问题,所以虽然目前用于多媒体内容的传输和使用的许多标准都已存在,但想要建立一个统一的完整体系还有很多问题需要解决。为了将不同的协议、标准和技术结合在L起,使得用户可以在现有的各种网络和设备上,透明地使用多媒体内容,实现互操作(Interoperability),需要建立一个开放的多媒体框架,所以出现了MPEG-21标准。

MPEG-21标准(ISO/IEC21000)的正式名称是多媒体框架,其制定工作于2000年6月开始。MPEG-21将创建一个开放的多媒体传输和消费的框架,通过将不同的协议、标准和技术结合在一起,使用户可以通过现有的各种网络和设备,透明地使用网络上的多媒体资源。MPEG-21中的用户可以是任何个人、团体、组织、公司、政府和其他主体,在MPEG-21中,用户在数字项的使用上拥有自己的权力,包括用户出版/发行内容的保护、用户的使用权和用户隐私权等。

MPEG-21包括数字项声明(Digital Item Declaration,DID)、数字项识别和描述、内容处理和使用、知识产权管理和保护、终端和网络、内容表示、事件报告7个基本要素。数字项是MPEG-21框架中的基本单元,它由资源、元数据(Metadata)和结构共同组成,是一个带有标准化的结构化数字对象。要素中的资源包括釆用MPEG-1、MPEG-2和MPEG-4标准的多媒体信息。通过数字项的定义,MPEG-21集成了MPEG系列的其他标准,由此也可以看出,MPWG-21是建立在其他标准的基础之上的。

MPWG-21标准支持内容创建、内容生产、内容分配、内容消费和使用、内容分组、知识产权管理和保护、内容识别和描述、用户权限、终端和网络资源提取,以及内容表示和时间报告等功能,该标准是从商业内容和与内容相关服务的前景等角度开发的,将同已有的其他MPEG系列标准等进行适当结合,从而使用户对视频和音频的处理更加方便和有效,最终为多媒体信息的用户在全球范围内提供透明而有效的视频通信应用环境。MPEG-21的出台可以将现有的标准统一起来,消费者将可以自由使用音/视频内容而不被不兼容的格式、编解码器、媒体数据类型及诸如此类的东西所干扰。

MPEG-21目前正与其他相关标准论坛合作,寻求尽可能地使用现有的标准以利于它们的无缝连接和综合应用。尽管MPEG今后还有很长的路要走,但其多媒体应用前景是令人期待的,目前存在的各种困难也必将得到解决。MPEG系列标准能够高效压缩多媒体数据,使多媒体数据的传输和存储查询技术向着更加全球化、规范化、灵活化和智能化的方向发展。

MPEG系列标准中的每个标准都是建立在前面标准的基础之上的,MPEG-1和MPEG-2是目前广泛应用的成熟的标准,MPEG-4是作为一个开放的多媒体标准出现在市场上而受到了瞩目并为多家厂商所采用的。后继标准MPEG-7及以后的MPEG-21标准的重点已经不在压缩方面,MPEG-7侧重于多媒体数据基于内容的描述,用来帮助运营者管理日益丰富的多媒体信息。而MPEG-21则更多侧重于多媒体信息内部使用的相关诸多方面。MPEG系列标准对多媒体以及相关产业产生了重大的影响,并将极大地推动多媒体通信领域的发展。我们有理由相信,MPEG系列标准的不断发展,必定会极大地促进今后信息产业的更加蓬勃的发展。

2、 WMV简介

Windows Media Video是微软为了和Real Networks的Real Video竞争而发展出来的一种可以直接在网上观看视频节目的文件压缩模式。

WMV格式是在微软的Windows Media核心的ASF(Advanced Stream Format,先进流格式)上升级延伸而来的,是微软的一系列流媒体视频技术的总称,是Windows平台媒体框架结构里的一部分。简单来说,它是一种数据格式,音频、视频、图像以及控制命令脚本等多媒体信息通过这种格式以网络数据包的形式传输,实现流式多媒体内容发布。

WMV技术并不单单是微软本身独有的技术,从版本7开始,微软已经开始使用它自己的MPEG-4压缩算法,所以,压缩率和图像的质量都很不错,在同等视频质量下,体积非常小,因此适合网络传输。我们经常看到的ASF和WMV就是Windows Media Video。Windows Media Video的编码质量明显好于RealVideo.因为Windows Media Video是微软的杰作,所以Windows系统对Windows Media Video给予了很好地支持,Windows Media Player可以直接播放这些文件。应该说,微软利用了它在操作系统领域的垄断地位弥补了它在Video方面的不足,使WMV技术快速占领了市场。除Window Media Player外,一些第三方的播放器也可以播放WMV格式的文件,例如,在Linux系统上用Mplayer播放WMV格式的文件,它利用Ffmpeg实现WMV的编解码。

WMV视频的原始图像数据存储格式存储在AV1或者ASF文件存储器里,目标文件如果是存储于AVI的文件存储器里,就命名为.avi文件;如果是存储于ASF的文件存储器里,就命名为.wmv或者.asf文件。但.wmv文件只是那些仅包含音视频内容的文件而已。在AVI文件存储器里,如果在Windows系统里用微软的WindowMediaVideo9VCM软件对文件进行编码,通常也能用WMV格式的文件。微软的WindowMediaPlayer并不支持所有WMV编码格式的文件。

为了进军全球消费电子、电影及电视广播市场,微软早已向美国电影与电视工程师协会(SMPTE)提交了其专有的WMV-9(WindowMediaVideo9),旨在使之成为行业标准的编解码器。但WMV-9的标准化进程并不顺利。2005年1月,活动图像和电视工程师协会已对递交的初稿进行了审查,将基于WMV-9的SMPTE标准称为VC-1。微软给人一种错觉,即WMV-9和SMPTE的VC-1是同—个相同的标准,但它们实际上是有区别的。WindowMedia包括许多不属于VC-1的东西,如数字版权管理、元数据、播放列表及用戸界面,而VC-1仅仅是一种视频压缩算法。

3、 H.264简介

JVT于2001年12月在泰国Pattaya成立,它由ITU-T和ISO两个国际标准化组织的有关视频编码的专家联合组成。JVT的工作目标是制定一个新的视频编码标准,以实现视频的高压缩比、高图像质量和良好的网络适应性等目标。目前JVT的工作已被ITU-T接纳,新的视频压缩解码标准称为H.264标准,该标准也被ISO接纳,称为AVC标准,是MPEG-4的第10部分。

H. 264标准可分以下3档:

• 基本档次——其版本简单,应用面广;

• 主要档次——采用了多项提高图像质量和增加压缩比的技术措施,可用于SDTV、HDTV和DVD等;

• 扩展档次——可用于各种网络的视频流传输。

I. H.264视频压缩系统构成

H.264标准压缩系统由视频编码层(VideoCodingLayer,VCL)和网络提取层(NetworkAbstractionLayer,NAL)两部分组成。VCL中包括VCL编码器与VCL解码器,主要功能是视频数据压缩编码和解码,它包括运动补偿、变化编码和炳编码等压缩单元。NAL则用于为VCL提供一个与网络无关的统一接口,负责对视频数据进行封装打包后使其在网络中传送。它采用统一的数据格式,包括单个字节的包头信息、多个字节的视频数据、组帧、逻辑信道信令、定时信息及序列结束信号等,包头中包含存储标志和类型标志,存储标志用于指示当前数据不属于被参考的帧,类型标志用于指示图像数据的类型。VCL可以传输按当前网络情况调整的编码参数。

2. H.264的主要特点

H.264和H.261、H.263一样,也是采用DCT变换编码加DPCM的差分编码,即混合编码结构。同时,H.264在混合编码的框架下,引入了新的编码方式,提高了编码效率,更贴近实际应用。

• H.264没有烦琐的选项,而是力求简洁,“回归基本”,它具有比H.263++更好的压缩性能,又具有适应多种信道的能力;

• H.264的应用目标广泛,可满足各种不同速率、不同场合的视频应用,具有较好的抗误码和抗丢包处理能力;

• H.264的基本系统无须使用版权,具有开放性质,能很好地适应IP和无线网络的使用,这对目前Internet传输多媒体信息和移动网中传输宽带信息等都具有重要意义。

(1)多种更好的运动估计

① 高精度估计。

在H.263中采用半像素估计,而在H.264中则进一步釆用1/4像素,甚至1/8像素的运动估计,即真正的运动矢量的位移可能是以1/4甚至1/8像素为基本单位的。显然,运动矢量位移的精度越高,则帧间剩余误差越小;传输码率越低,即压缩比越高。

在H.264中,采用6阶FIR滤波器的内插获得1/2像素位置的值。当1/2像素值获得后,1/4像素值可通过线性内插获得。对于4:1:1的视频格式,亮度信号的1/4像素精度对应于色度部分的1/8像素的运动矢量,因此,需要对色度信号进行1/8像素的内插运算。

理论上,如果将运动补偿的精度增加一倍(例如,从整像素精度提高到1/2像素精度),可有0.5bit/Sample的编码增益,但实际验证发现,在运动矢量精度超过1/8像素后,系统基本上就没有明显增益了,因此,在H.264中,一般只釆用了1/4像素精度的运动矢量模式,而不是釆用1/8像素的精度。

② 多宏块划分模式估计。

在H.264的预测模式中,一个宏块(MB)可划分成7种不同模式的尺寸,这种多模式的灵活、细微的宏块划分,更切合图像中的实际运动物体的形状,于是,在每个宏块中,可包含有1,2,4,8或16个运动矢量。

③ 多参数帧估计。

在H.264中,可采用多个参数帧的运动估计,即在编码器的缓存中有多个刚刚编好码的参数帧,编码器从其中选择一个编码效果最好的帧作为参数帧,并指出是哪个帧被用于预测,这样就可获得比只用上一个刚编好码的帧作为预测帧更好的编码效果。

(2)小尺寸4x4的整数变换

视频压缩编码中以往的常用单位为8x8块,在H.264中却采用小尺寸的4x4块。由于变换块的尺寸变小了,运动物体的划分就更为精确。在这种情况下,图像变换过程中的计算量小了,而且在运动物体边缘的衔接误差也大为减少。

当图像中有较大面积的平滑区域时,为了不产生因小尺寸变换带来的块间灰度差异,H.264可对帧内宏块亮度数据的16个4x4块的DCT(DiscreteCosineTransform,离散余弦变换)系数进行第二次4x4块的变换,对色度数据的4个4x4块的DCT系数(每个小块一个,共4个DC系数)进行2x2块的变换。

H.264不仅使图像变换块尺寸变小,而且这个变换是整数操作,而不是实数运算,即编码器和解码器的变换和反变换的精度相同,没有“反变换误差”。

(3)更精确的帧内预测

在H.264中,每个4x4块中的每个像素都可用17个最接近先前已编码的像素的不同加权和来进行帧内预测。

(4)通用可变长度码(UniversalVariableLengthCoding,UVLC)

熵编码是视频编码过程中的最后一步,H.264中有两种炳编码方法。一种是对通用可变长度码的应用,UVLC使用一个相同的码表进行编码,而解码器很容易识别码字的前缀,UVLC在发生比特错误时能快速获得重同步:另一种是基于上下文自适应二进制算术编码(Context Adaptive Binary Arithmetic Coding,CABAC),其编码性能比UVLC稍好,但复杂度较高。

3. 性能优势

H.264与MPEG-4和H.263++编码性能对比采用了以下6个测试速率:32kbps,10F/s和QCIF(Quarter Common Intermedia Format,四分之一中间格式);64kbps,15F/s和QCIF;128kbps,15F/s和CIF(Common Intermedia Format,普通中间格式);256kbps,15F/s和QCIF;512kbps,30F/s和CIF;1024kbps,30F/s和CIF。测试结果表明,H.264具有比MPEG和H.263++更好的PSNR性能,H.264的PSNR比MPEG-4平均要高2dB,比H.263++平均要高3dB。

H.264比H.263和MPEG-4节约了50%的码率,而且对网络传输具有更好的支持功能。它引入了面向IP包的编码机制,有利于网络中的分组传输,支持网络中视频的流媒体传输。H.264具有较强的抗误码特性,可适应丢包率高、干扰严重的无线信道中的视频传输。H.264支持不同网络资源下的分级编码传输,从而获得平稳的图像质量。H.264能适应于不同网络中的视频传输,网络亲和性好。

4. 新的快速运动估值算法

新的快速运动估值算法UMHexagonS(中国专利)是一种运算量相对于H.264中原有的快速全搜索算法可节约90%以上的新算法,全名为“非对称十字型多层次六边形格点搜索算法”(Unsymmetrical-CrossMuti-Hexagon Search,UCMHS).这是一种整像素运动估值算法。由于它在高码率大运动图像序列编码时,在保持较好率失真性能的条件下,运算量十分低,已被H.264标准正式釆纳。

H.264标准使运动图像压缩技术上升到了一个更高的阶段,在较低带宽上提供高质量的图像传输是H.264的应用亮点。H.264的推广应用对视频终端、网守、网关和MCU等系统的要求较高,将有力地推动视频会议软、硬件设备在各个方面的不断完善。

H.264(MPEG-4Part10)有可能被广播、通信和存储媒体(CD、DVD)接受成为统一的标准,最有可能成为宽带交互新媒体的标准。我国的信源编码标准尚未制定,密切关注H.264的发展,制定我国的信源编码标准的工作正在加紧进行。